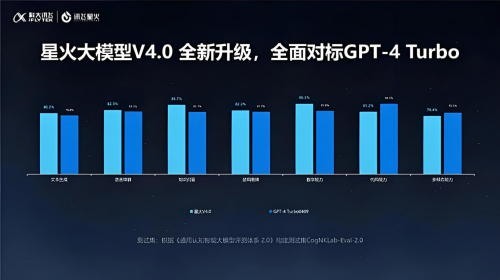

当前,“百模大战”带来了算力需求的爆发,尤其是以ChatGPT为代表的多模态AI大模型,其参数规模和训练数据量均达到了前所未有的规模。GPT-3.5、GPT-4等模型的参数规模突破了万亿级别,训练数据量达到了TB级别,这使得大模型训练成为了一个计算密集型的任务,对算力的需求极高。

近日,浪潮计算机重磅推出基于安全架构的训练型AI服务器NF5698H7,适用于大模型训练、高性能计算、数据分析等多种应用场景,具有性能卓越、随需扩展、稳定可靠、维护便捷和智能调节散热等特点,构建多场景的最强AI创新算力平台。

高速互联是大规模算力集群构建的基础。芯片间、服务器间、集群间的高速互联、无损网络能力建设,是支撑千卡、万卡智能算力集群计算需求的必备条件,大模型的训练需要融合多种并行策略,对卡间P2P互联带宽以及跨节点互联带宽提出了更高的要求。浪潮NF5698H7服务器支持8颗创新全互联OAM加速计算模组,支持高带宽内存,高速网络平面,支持12个PCIe4.0扩展槽位,节点间高速互联扩展,无阻塞带宽RoCE组网,集群级优化架构设计,实现数据网、存储网、管理网分离,满足千亿级参数超大模型并行训练需求。

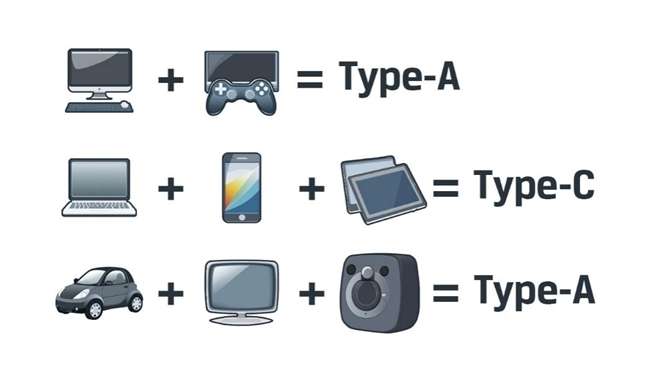

在产业落地过程中,国内各厂商的加速卡存在硬件接口不统一、互联协议不统一,同时软件生态互不兼容的情况,带来了新型AI加速卡系统适配周期长、定制投入成本高的落地难题,行业亟需更加开放的算力平台,以及更加多元的算力支撑大模型的训练。浪潮NF5698H7服务器一机兼容适配国内最新多类型、多品牌AI加速卡,支持DeepSpeed、Megatron等主流分布式AI训练框架,满足各种AI应用场景下对异构计算算力的极致需求。针对多元芯片管理和调度难题,NF5698H7兼容适配浪潮AI算力调度平台——inAIP智算平台,通过对计算资源、数据资源、深度学习软件栈资源进行统一管理,简化AIGC、CV、NLP模型的开发和部署流程,有效提升大模型算力平台的使用效率,满足用户更成熟、易部署、更便捷的开放生态需求。

大模型对算力的巨大需求,带来了对能源的巨大消耗。据了解,人工智能服务器的功率较普通服务器高6至8倍,训练大模型所需的能耗是常规云工作的3倍。浪潮NF5698H7服务器采用风道解耦设计,通过智能分层调节散热,优化散热性能,相比同级别产品,NF5698H7服务器功耗降低约20%。产品采用12V和54V N+N冗余电源分离供电设计,实现高功耗负载动态匹配,减少电源转换损耗,赋能企业绿色低碳发展。

目前,浪潮计算机已与国内知名互联网企业、云厂商、金融机构等众多行业龙头企业开展深度合作, 为深度学习模型训练、深度学习推理、高性能计算、数据分析、图像视频、语音识别、金融分析、智能客服等典型应用场景提供了开放、高效、安全的AI算力支撑。未来基于多元化AI服务器,浪潮计算机将持续为大模型的发展创新提供高质量算力底座,助力各行业向数智化高速发展。